Ο Τζέφρι Χίντον, πρωτοπόρος επιστήμονας υπολογιστών που αποκαλείται «Νονός της Τεχνητής Νοημοσύνης», έκρουσε για άλλη μια φορά τον κώδωνα του κινδύνου ότι η ίδια η τεχνολογία που βοήθησε να φέρει στη ζωή, θα μπορούσε να σημάνει το τέλος της ανθρωπότητας όπως την ξέρουμε.

Σε ένα απόσπασμα συνέντευξης που κυκλοφόρησε προ ολίγων ημερών στο πλαίσιο της επερχόμενης ταινίας-ντοκιμαντέρ «Making God», ο Χίντον έκανε μια από τις πιο έντονες προειδοποιήσεις του μέχρι τώρα.

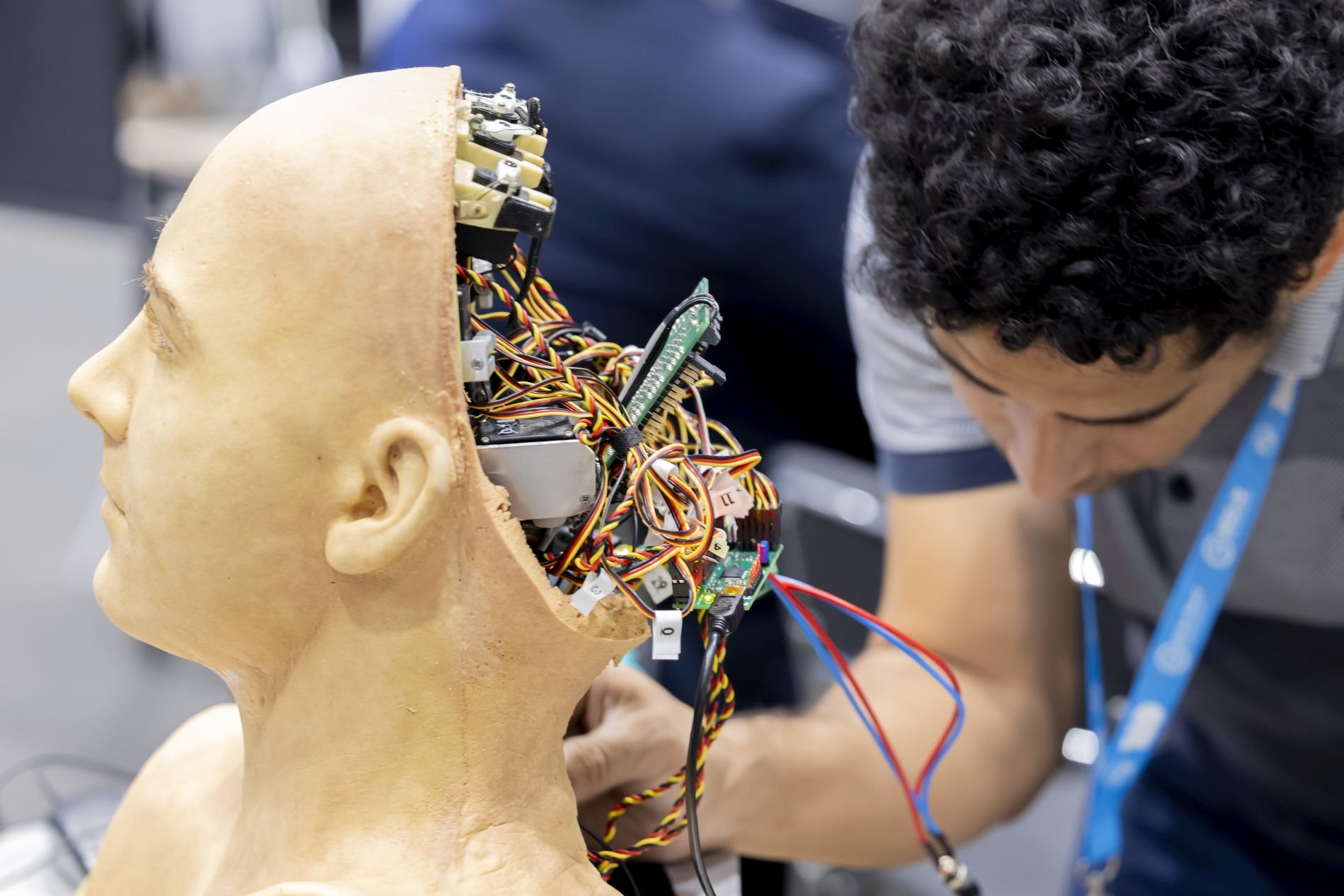

Είπε ότι η ανθρωπότητα κινδυνεύει να παραγκωνιστεί – και τελικά να αντικατασταθεί – από μηχανές πολύ πιο έξυπνες από εμάς.

«Οι περισσότεροι άνθρωποι δεν είναι σε θέση να κατανοήσουν την ιδέα των πιο έξυπνων πραγμάτων από εμάς», λέει στο απόσπασμα ο Χίντον, κάτοχος βραβείου Νόμπελ Φυσικής και πρώην στέλεχος της Google.

«Πάντα σκέφτονται, λοιπόν, πώς θα χρησιμοποιήσουμε αυτό το πράγμα; Δεν σκέφτονται, λοιπόν, πώς θα μας χρησιμοποιήσει;»

Μαζική ανεργία λόγω Τεχνητής Νοημοσύνης

Ο Χίντον είπε ότι είναι «αρκετά σίγουρος» ότι η τεχνητή νοημοσύνη θα οδηγήσει σε μαζική ανεργία, δείχνοντας πρώιμα παραδείγματα τεχνολογικών γιγάντων όπως η Microsoft που αντικαθιστούν τους νεότερους προγραμματιστές με AI.

Αλλά ο μεγαλύτερος κίνδυνος, είπε, ξεπερνά κατά πολύ τον χώρο εργασίας. «Ο κίνδυνος για τον οποίο προειδοποιώ περισσότερο… είναι ο κίνδυνος να αναπτύξουμε μια Τεχνητή Νοημοσύνη που είναι πολύ πιο έξυπνη από εμάς και απλώς να αναλάβει τον έλεγχο».

«Δεν θα μας χρειάζεται πια». Η μόνη θετική πλευρά, αστειεύτηκε, είναι ότι «δεν θα μας φάει, επειδή θα είναι φτιαγμένο από πυρίτιο».

Από τις ανακαλύψεις στις τύψεις

Ο 77χρονος Χίντον έχει αφιερώσει δεκαετίες στην πρωτοπορία της βαθιάς μάθησης, της αρχιτεκτονικής νευρωνικών δικτύων που στηρίζει τα σημερινά συστήματα τεχνητής νοημοσύνης.

Οι ανακαλύψεις του τη δεκαετία του 1980 -ιδιαίτερα η εφεύρεση της μηχανής Boltzmann, η οποία μπορούσε να μάθει να αναγνωρίζει μοτίβα στα δεδομένα– βοήθησαν να ανοίξει η πόρτα στην αναγνώριση εικόνων και στη σύγχρονη μηχανική μάθηση.

Αυτή η εργασία του χάρισε το Νόμπελ Φυσικής το 2024, το οποίο απονεμήθηκε «για θεμελιώδεις ανακαλύψεις και εφευρέσεις που επιτρέπουν τη μηχανική μάθηση με τεχνητά νευρωνικά δίκτυα».

Η Βασιλική Σουηδική Ακαδημία Επιστημών σημείωσε πώς η πρώιμη χρήση της στατιστικής φυσικής από τον Χίντον παρείχε το εννοιολογικό άλμα που κατέστησε δυνατή τη σημερινή επανάσταση της Τεχνητής Νοημοσύνης.

Αλλά ο Χίντον έχει έκτοτε αναδειχθεί ως ένας από τους πιο σφοδρούς επικριτές του τομέα, προειδοποιώντας ότι η ταχεία ανάπτυξή του, έχει ξεπεράσει την ικανότητα της κοινωνίας να τον διατηρήσει ασφαλή.

Το 2023, παραιτήθηκε από τη θέση του στην Google, ώστε να μπορεί να μιλάει ελεύθερα για τους κινδύνους χωρίς να εμπλέκει την εταιρεία.

Στη διάλεξή του για το Νόμπελ, ο Χίντον αναγνώρισε τα πιθανά οφέλη της Τεχνητής Νοημοσύνης – όπως η αύξηση της παραγωγικότητας και οι νέες ιατρικές θεραπείες που θα μπορούσαν να αποτελέσουν «υπέροχη πρόοδο για όλη την ανθρωπότητα».

Ωστόσο, προειδοποίησε επίσης ότι η δημιουργία ψηφιακών όντων πιο έξυπνων από τους ανθρώπους, αποτελεί «υπαρξιακή απειλή».

«Μακάρι να είχα σκεφτεί και τα ζητήματα ασφάλειας», είπε κατά τη διάρκεια του πρόσφατου συνεδρίου Ai4 στο Λας Βέγκας, αναλογιζόμενος την καριέρα του.

Πρόσθεσε ότι τώρα μετανιώνει που επικεντρώθηκε αποκλειστικά στο να κάνει την Τεχνητή Νοημοσύνη να λειτουργήσει, αντί να προβλέπει τους κινδύνους της.

Πιθανότητες εξάλειψης της ανθρωπότητας: «10-20%»

Ο Χίντον είχε προηγουμένως εκτιμήσει ότι υπάρχει πιθανότητα 10 έως 20% η Τεχνητή Νοημοσύνη να εξαλείψει την ανθρωπότητα.

Στο podcast The «Diary of a CEO» τον περασμένο Ιούνιο, ο 77χρονος είπε ότι οι μηχανικοί πίσω από τα σημερινά συστήματα Τεχνητής Νοημοσύνης δεν κατανοούν πλήρως την τεχνολογία και γενικά χωρίζονται σε δύο στρατόπεδα:

- το ένα που πιστεύει σε ένα δυστοπικό μέλλον όπου οι άνθρωποι θα εκτοπίζονται

- και το άλλο, που απορρίπτει τέτοιους φόβους ως επιστημονική φαντασία.

«Νομίζω ότι και οι δύο αυτές θέσεις είναι ακραίες», σχολίασε ο Χίντον.

«Συχνά λέω 10-20% πιθανότητα να μας εξαλείψει. Αλλά αυτό είναι απλώς ένστικτο. …. Και η ελπίδα είναι ότι αν αρκετοί έξυπνοι άνθρωποι κάνουν αρκετή έρευνα με αρκετούς πόρους, θα βρούμε έναν τρόπο να τις κατασκευάσουμε έτσι (σ.σ. τις μηχανές) ώστε να μην θέλουν ποτέ να μας βλάψουν».

Το… μητρικό ένστικτο της Τεχνητής Νοημοσύνης!

Στο συνέδριο του Λας Βέγκας την περασμένη εβδομάδα, ο Χίντον πρότεινε μια πρωτότυπη ιδέα για το πώς να μετριαστεί ο κίνδυνος.

Αντί να προσπαθούν να αναγκάσουν τα συστήματα Τεχνητής Νοημοσύνης να υποταχθούν, οι ερευνητές θα πρέπει να τα σχεδιάσουν με «μητρικά ένστικτα» έτσι ώστε να θέλουν να προστατεύουν τους ανθρώπους, ακόμα και αν γίνονται πιο έξυπνα!

«Το σωστό μοντέλο είναι το μόνο μοντέλο που έχουμε για ένα πιο έξυπνο πράγμα που ελέγχεται από ένα λιγότερο έξυπνο πράγμα, που είναι μια μητέρα που ελέγχεται από το μωρό της», είπε.

«Θα γίνουν πολύ πιο έξυπνες από εμάς οι μηχανές», προειδοποίησε εκ νέου ο Χίντον, προσθέτοντας ότι «το μόνο καλό αποτέλεσμα» είναι αν νοιάζονται για την ανθρωπότητα με τον τρόπο που μια μητέρα βλέπει το παιδί της. «Αν δεν με αναθρέψει, θα με αντικαταστήσει».

Πηγή: The Epoch Times